Künstliche Intelligenz ist in unserem Alltag angekommen. Wir haben uns an ChatGPT gewöhnt, das Texte schreibt, codet und komplexe Fragen für uns in kürzester Zeit beantwortet. Doch diese Ära der textbasierten KI ist bereits wieder Geschichte.

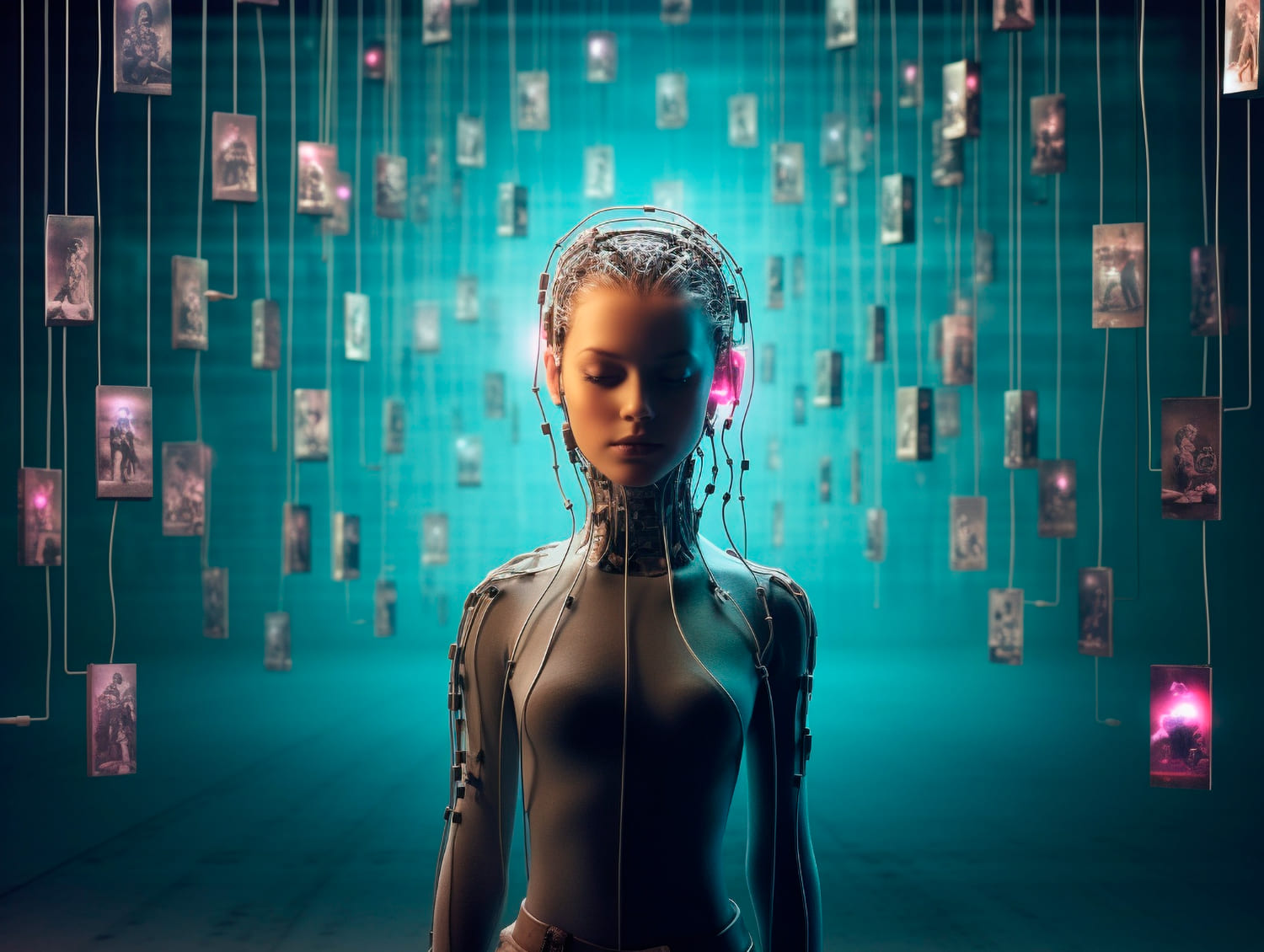

Künstliche Intelligenz durchläuft gerade eine gigantische Evolutionsstufe: Die Rede ist von multimodaler KI. Das sind KI-Systeme, die nicht nur eine, sondern mehrere „Modalitäten“ gleichzeitig verarbeiten und verstehen können, zum Beispiel Text, Bilder, Audio und Video. Die KI erwirbt gewissermaßen ihre „Sinne“.

Kombiniert mit den bereits bekannten generativen Modellen (die etwas erschaffen), eröffnet diese Technologie völlig neue, fast magische Möglichkeiten: KI, die sieht, hört, spricht und in der Lage ist, die Welt wie wir wahrzunehmen und kreativ zu erzeugen.

In diesem Artikel werfen wir einen fundierten Blick hinter die Kulissen: Wir erklären die Grundlagen, beleuchten die neuesten technischen Entwicklungen, zeigen konkrete Anwendungsfälle, diskutieren die Chancen und Risiken und stellen Ihnen die wichtigsten Modelle vor. So erhalten Sie ein klares Verständnis davon, was multimodale generative KI heute leisten kann und vor allem wohin die Reise als Nächstes geht.

Was ist multimodale KI?

Um die multimodale Entwicklung zu verstehen, müssen wir zunächst klären, was die KI unter einer „Modalität“ versteht:

Modalitäten: Die Sinne der KI

Eine „Modalität“ bezeichnet bei KI im Grunde eine Art von Daten oder eine Form der Eingabe, vergleichbar mit unseren menschlichen Sinnen.

- Unimodale KI hatte bisher nur einen Sinn (z.B. Text bei älteren Sprachmodellen).

- Multimodale KI verarbeitet mehrere dieser Sinne gleichzeitig: Text, Bilder, Audio, Video, Sensordaten usw.

Diese Fähigkeit, verschiedene Modalitäten parallel zu verarbeiten, ermöglicht eine viel reichere und menschenähnlichere Interaktion als alles, was reine Text-KI bisher leisten konnte.

Die wahre Magie: Gemeinsame Repräsentation

Der Unterschied zu herkömmlicher KI ist fundamental:

| Typ | Fokus | Beispiel |

| Unimodale KI | Beherrscht nur eine Sprache (z.B. nur Text oder nur Bilderkennung). | Klassische Large Language Models (LLMs) wie ältere GPT-Versionen. |

| Multimodale KI (MLLM) | Kann zwei oder mehr Sprachen gleichzeitig verstehen. | Multimodale Large Language Models (MLLMs) verbinden Text mit Bild und Audio. |

(Quelle: arXiv)

Die Magie der multimodalen Modelle liegt darin, dass sie Verknüpfungen zwischen den Modalitäten herstellen. Die KI lernt eine Art universelles Vokabular (die sogenannte gemeinsame Repräsentation). Wenn Sie der KI ein Bild zeigen und sie bitten, dieses zu beschreiben, nutzt sie dieses gemeinsame Vokabular, um visuelle Informationen in sprachliche (Text) zu übersetzen. Dadurch versteht die KI die Welt vielschichtiger.

Technologische Entwicklung & Trends: Der Blick unter die Haube

Die multimodale KI ist kein Zufallsprodukt, sondern das Ergebnis jahrelanger, komplexer Forschungsarbeit. Die Fortschritte basieren auf der Kombination von bekannten und neuen Architekturen, die es der KI erlauben, ihre „Sinne“ zu verbinden.

Neue Architektur: Das Übersetzungszentrum der KI

Die Basis bilden weiterhin die leistungsstarken Transformer-Architekturen (bekannt aus GPT). Um jedoch Cross-Modalität zu ermöglichen, müssen Bilder, Ton und Text zunächst verarbeitet und dann an einem gemeinsamen Ort zusammengeführt werden:

- Der gemeinsame Vokabular-Raum (Latent Space): Forscher nutzen einen gemeinsamen latenten Raum (Latent Space). Das ist der „Ort“, an dem die KI die visuellen Informationen eines Bildes und die sprachlichen Informationen eines Textes in dasselbe interne Vokabular übersetzt. Nur so kann die KI sagen: „Das Bild des roten Apfels entspricht dem Wort ‚roter Apfel‘.“ (Quelle: arXiv)

- Fundamentale Trainingsmethoden: Techniken wie Self-Supervised Learning (SSL), das Modell-Aufteilen per Mixture of Experts (MoE) und die Feinabstimmung durch menschliches Feedback (RLHF) ermöglichen es den Modellen, Wissen über verschiedene Modalitäten hinweg zu integrieren. (Quelle: arXiv)

Prognose: Multimodalität wird zum Standard

Dieser technologische Fortschritt führt zu einem explosionsartigen Wachstum im Markt.

Laut dem Marktforschungsunternehmen Gartner wird sich der Trend massiv verstärken: Bis 2027 sollen 40 % aller generativen KI-Lösungen multimodal sein, verglichen mit nur 1 % im Jahr 2023. Das bedeutet, dass es in wenigen Jahren die absolute Ausnahme sein wird, wenn eine neue KI nicht sehen und hören kann. (Quelle: Gartner)

Vom Sprachmodell zum echten KI-System

Forscher argumentieren: Wir sollten multimodale KI nicht mehr nur als „großes Sprachmodell“ denken. Stattdessen sollten wir sie als Generative AI Systems verstehen. Diese Systeme bestehen aus einer modularen Architektur, die Datenbanken, spezialisierte Ein- und Ausgabemodule (für Bild, Audio etc.) und die eigentlichen generativen Modelle verbindet. Erst dieser systembasierte Ansatz ermöglicht eine echte, allumfassende Systemintelligenz. (Quelle: arXiv)

Anwendungsfälle: Die Multimodale KI in der Praxis

Multimodale KI ist kein bloßes Forschungsprojekt, sondern übersetzt die technologische Leistungsfähigkeit schon heute in konkrete Vorteile für Wirtschaft, Wissenschaft und Alltag. Hier sehen Sie, wo die KI ihre neuen „Sinne“ einsetzt:

Kreativität & Content: Der multimediale Turbo

Dies ist der sichtbarste Bereich der multimodalen Revolution. Die KI agiert hier als Co-Creator:

- Synchrone Content-Generierung: KI erschafft Geschichten, die nicht nur geschrieben, sondern parallel mit passenden Illustrationen oder Videos versehen werden.

- Interaktive Medien: Generierung kompletter multimedialer Szenen, wobei Musik, Audio und Visuelles perfekt synchronisiert und auf Nutzereingaben hin dynamisch angepasst werden.

Unternehmen & Produktivität: Agenten mit Augen

Multimodale Modelle werden zum intelligenten Mitarbeiter, der nicht nur Texte liest, sondern auch das Gesehene versteht:

- Visuelle Assistenten: Chatbots, die auf einem einzigen Screenshot oder einem Foto ein Problem erkennen, analysieren und sofort eine visuelle oder textuelle Lösung (Anleitung) generieren können.

- Smarte Dokumentenanalyse: KI interpretiert komplexe Dokumente, indem sie Text zusammen mit eingebetteten Bildern, Tabellen oder Diagrammen versteht, was für eine rein textbasierte KI unmöglich war.

Medizin & Forschung: Der Diagnose-Sprung

Die Integration verschiedener Datenquellen revolutioniert Präzision und Geschwindigkeit auch in sensiblen Bereichen:

- Ganzheitliche Diagnostik: Modelle analysieren radiologische Bilder (z. B. Röntgen, MRT) zusammen mit dem dazugehörigen Arztbericht, um die Diagnosestellung zu unterstützen und die Fehlerquote zu minimieren.

- Automatisierte Berichterstattung: KI generiert komplexe Prüfberichte, die Messdaten, erklärenden Text, Bilder und Empfehlungen nahtlos zusammenfügen.

Bildung & E-Learning: Wissen wird erlebbar

Multimodale KI macht Lernprozesse individueller und anschaulicher:

- Intelligente Lernmaterialien: Auf Knopfdruck generiert die KI Unterrichtsmaterialien, die sofort Diagramme, Illustrationen oder interaktive Visualisierungen enthalten.

- Visuelle Tutoren: Die KI antwortet auf Schülerfragen nicht nur mit einem Textabschnitt, sondern kann komplizierte Sachverhalte mit Erklärvideos oder interaktiven Grafiken vermitteln.

Die Balance zwischen Chancen und Risiken ist für einen fundierten Artikel essenziell. Ich habe die beiden Abschnitte getrennt strukturiert, um die Argumentation zu schärfen und die wichtigsten Punkte hervorzuheben.

Chancen & Potenziale: Was diese KI ermöglicht

Die Multimodalität ist kein nettes Extra, sondern ein strategischer Game-Changer. Die Verschmelzung der „Sinne“ eröffnet Potenziale, die weit über das hinausgehen, was textbasierte Modelle leisten konnten.

Mensch-KI-Interaktion auf neuem Level

- Der intuitive Assistent: Multimodale KI kann uns sehen (Bild), unsere Stimme hören (Audio) und entsprechend reagieren. Das führt zu weitaus natürlicheren und intuitiveren Interfaces – der Assistent ist endlich wirklich „da.“

- Beschleunigte Kreativität: Kreativprozesse in Marketing, Design und Content-Produktion lassen sich radikal beschleunigen, da KI Inhalte (Text, Bild, Video) automatisch generiert oder perfekt ergänzt.

Neue Geschäftsmodelle & Wettbewerbsvorteil

- Branchen-Innovation: Völlig neue Produkte und Dienstleistungen entstehen in Branchen, die stark auf visuelle und akustische Daten angewiesen sind, wie Medien, Gaming, Bildung und Gesundheitswesen.

- Der Wettbewerbs-Turbo: Wer frühzeitig in multimodale generative KI investiert, verschafft sich einen signifikanten Wettbewerbsvorteil und kann innovative Anwendungen schneller als die Konkurrenz am Markt platzieren.

Herausforderungen & Risiken: Die Kehrseite der Medaille

Wo großes Potenzial ist, sind auch große Herausforderungen. Die Komplexität multimodaler Systeme bringt neue technische, ethische und regulatorische Probleme mit sich, die nicht ignoriert werden dürfen!

Technische und ökonomische Hürden

- Ressourcenintensives Training: Das Training multimodaler Modelle ist extrem ressourcenintensiv. Es erfordert riesige, gut kuratierte Datensätze (Text + Bild + Audio, etc.) und eine entsprechend leistungsfähige, spezialisierte Hardware. (Quelle: arXiv)

- Energieverbrauch: Modelle, die mehrere Modalitäten unterstützen, benötigen oft deutlich mehr Rechenleistung, was zu einem erhöhten Energieverbrauch führt.

Ethische und regulatorische Fragen

- Interpretierbarkeit und Blackbox: Wenn ein Modell gleichzeitig Bilder, Ton und Text verarbeitet, wird es exponentiell schwieriger, die Entscheidungsprozesse transparent und nachvollziehbar zu machen (Erklärbarkeit).

- Datenschutz und Sensibilität: Multimodale KI verarbeitet besonders sensible biometrische Daten (z. B. Gesichter, Stimmen, private Bilder). Der umfassende Schutz dieser Daten ist eine der größten rechtlichen Herausforderungen.

- Bias und Missbrauch: Generative KI kann für täuschend echte Deepfakes missbraucht werden. Zudem besteht die Gefahr, dass Bias aus den Trainingsdaten zu verzerrten oder falschen Inhalten führt.

Zukunftsaussichten & Innovationen: Wohin die Reise geht

Die Entwicklung der multimodalen KI steht erst am Anfang. Die nächsten großen Sprünge werden sich auf Autonomie, Zugänglichkeit und Nachhaltigkeit konzentrieren:

Der autonome Wandel

- Multimodale Agenten: Die KI wird vom reinen Werkzeug zum autonomen Mitarbeiter. Zukünftige Agenten können nicht nur generieren und verstehen, sondern autonom komplexe Aufgaben übernehmen, von der Planung über die Recherche bis zur gesamten kreativen Produktion.

- Edge-Multimodalität: KI-Modelle laufen nicht mehr nur in riesigen Rechenzentren. Zukünftig werden multimodale Modelle direkt auf Edge-Geräten (Smartphones, Smartwatches) laufen. Das bedeutet extrem geringe Latenz und einen massiven Vorteil beim Datenschutz, da die Daten das Gerät nicht verlassen müssen.

Effizienz und Reichweite

- Effiziente Architekturen: Fortschritte in der Modellarchitektur (z. B. sparsames Training, Modularisierung) werden den Energiebedarf senken und multimodale KI dadurch zugänglicher und kostengünstiger machen. Die Forschung arbeitet intensiv an „grüner KI„.

- Breite Gesellschaftliche Nutzung: Multimodale KI wird in Bildung, Gesundheit und Unterhaltung zu einem selbstverständlichen Werkzeug. Die Technologie wird den Tech-Bereich verlassen und im täglichen Leben jedes Einzelnen präsent sein.

Bedeutung für deine Tech-Strategie

Die multimodale Revolution ist kein passiver Trend. Sie erfordert eine aktive strategische Neuausrichtung. Hier erfahren Sie, was diese Entwicklung konkret für Ihre Rolle bedeutet:

| Zielgruppe | Strategischer Fokus | Was jetzt zählt |

| Für Unternehmen | Differenzierung & Kundenerlebnis | Frühzeitige Planung: Überlegen Sie, wie Sie multimodale Ansätze nutzen können, um Produkte zu differenzieren und völlig neue, intuitive Kundenerlebnisse zu schaffen. |

| Für Entwickler & Forscher | Kernkompetenz in MLLMs | Spezialwissen aufbauen: Kenntnisse in Cross-Modal-Training, modularen Architekturen und der Sammlung multimodal anwendbarer Daten werden zur Schlüsselqualifikation. |

| Für die Gesellschaft | Verantwortungsvolle Nutzung | Informierte Diskussion: Die Technologie wirft fundamentale Fragen zu Ethik, Datenschutz und Regulierung auf. Nur eine breite, informierte Diskussion kann eine verantwortungsvolle und faire Nutzung sicherstellen. |

Fazit: Die Ära der vollständigen KI

Multimodale generative KI steht an einem entscheidenden Wendepunkt: Sie verbindet die Welten von Text, Bild, Audio und Video zu einem leistungsfähigen, ganzheitlichen Verständnis. Dank technischer Innovationen entstehen neue, fast menschliche Formen der Interaktion und Kreativität.

Gleichzeitig sind die Herausforderungen (in Sachen Energie, Datenschutz und Erklärbarkeit) nicht zu unterschätzen. Verantwortungsvolles Handeln ist hier der Schlüssel.

Für Unternehmen, Entwickler und die breitere Gesellschaft gilt: Wer sich früh mit multimodaler KI auseinandersetzt, kann nicht nur von den technologischen Vorteilen profitieren, sondern aktiv mitgestalten, wie diese Technologie verantwortungsvoll und innovativ eingesetzt wird.

Welche multimodale KI-Anwendung fasziniert Sie am meisten? Teilen Sie Ihre Meinung mit uns in den Kommentaren.

Häufige Fragen (FAQ) zu multimodaler generativer KI

| Frage | Antwort |

| Was ist der Unterschied zur klassischen KI? | Multimodale KI verarbeitet mehrere Arten von Daten (z. B. Bild, Ton, Text) gleichzeitig, während klassische Sprachmodelle nur mit Text arbeiten. |

| Welche Daten braucht ein multimodales Modell? | Solche Modelle benötigen multimodale Datensätze (Text + Bild + Audio), die idealerweise miteinander synchronisiert und annotiert sind. |

| Ist multimodale KI auch für kleinere Projekte geeignet? | Ja, zunehmend. Dank Open-Source-Modellen und effizienteren Architekturen können auch kleinere Unternehmen und Entwickler von multimodaler KI profitieren. |

| Welche Datenschutzrisiken bestehen? | Da multimodale Systeme z. B. Bilder oder Stimmen verarbeiten, ist der Schutz persönlicher Daten besonders wichtig. Es braucht strenge Richtlinien. |

| Wird multimodale KI energieintensiv sein? | Derzeit ja. Große Modelle verbrauchen viel Rechenleistung. Zukünftige Architektur-Trends zielen aber darauf ab, effizientere, ressourcenschonendere Modelle zu entwickeln. |